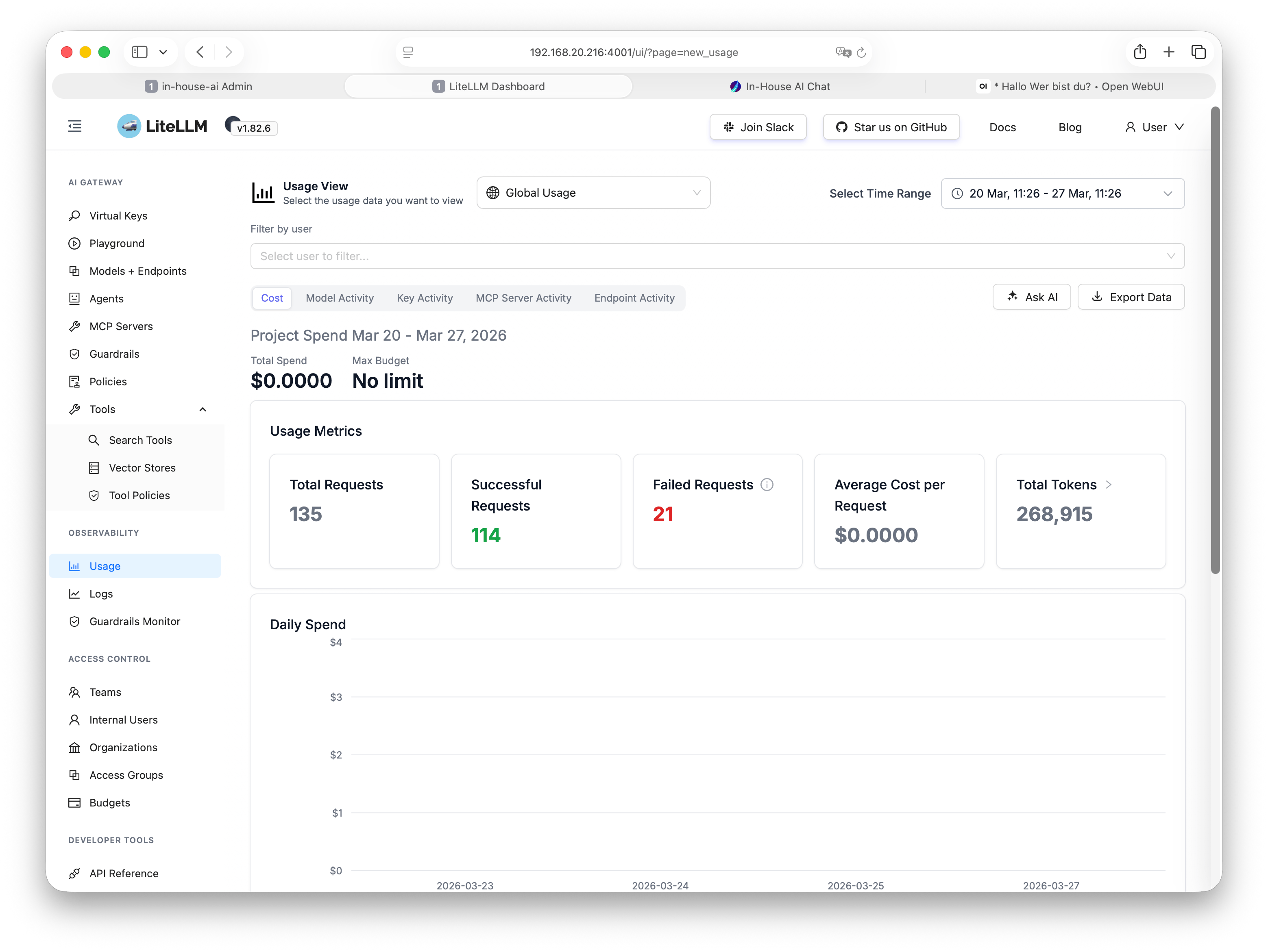

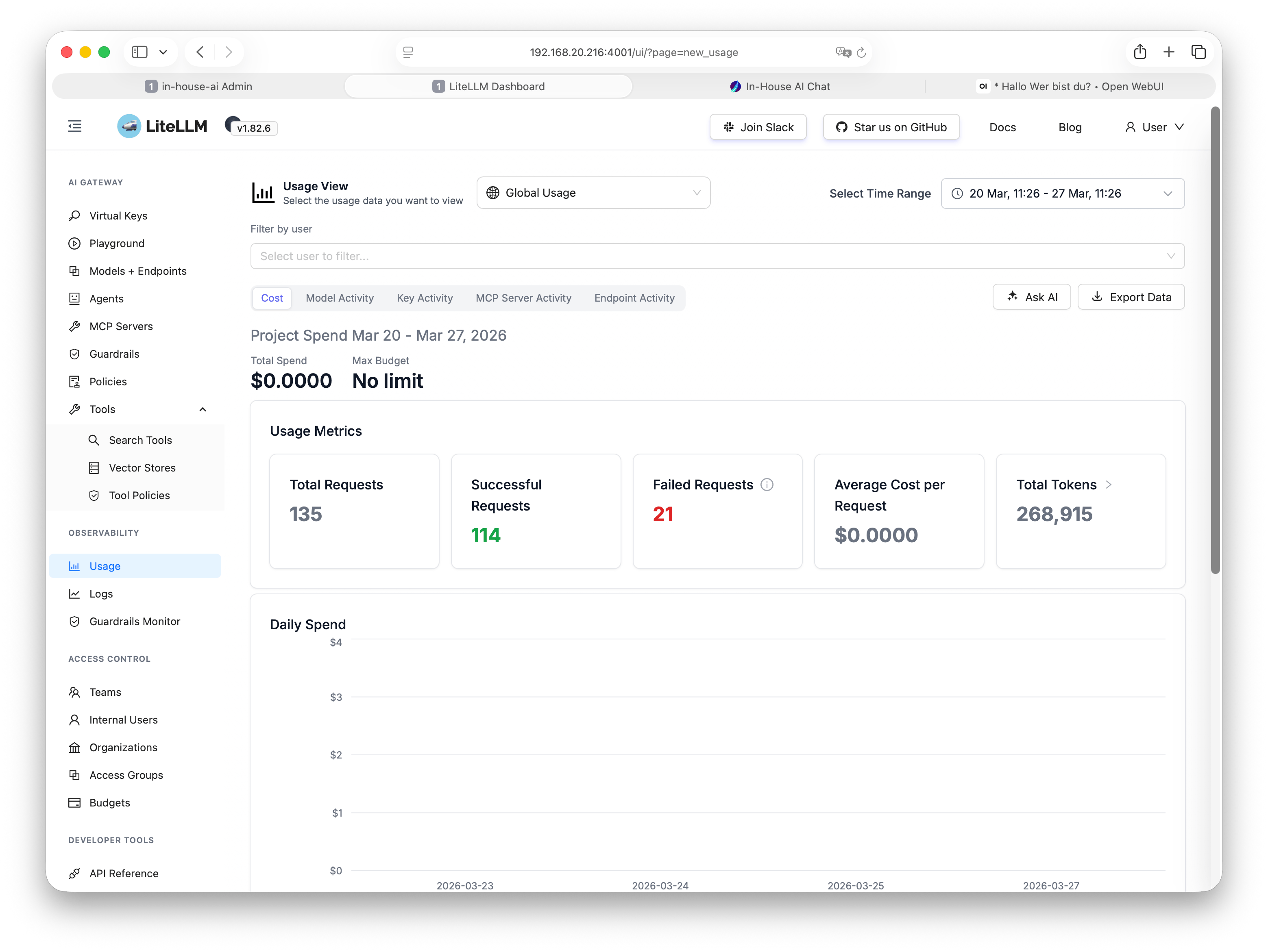

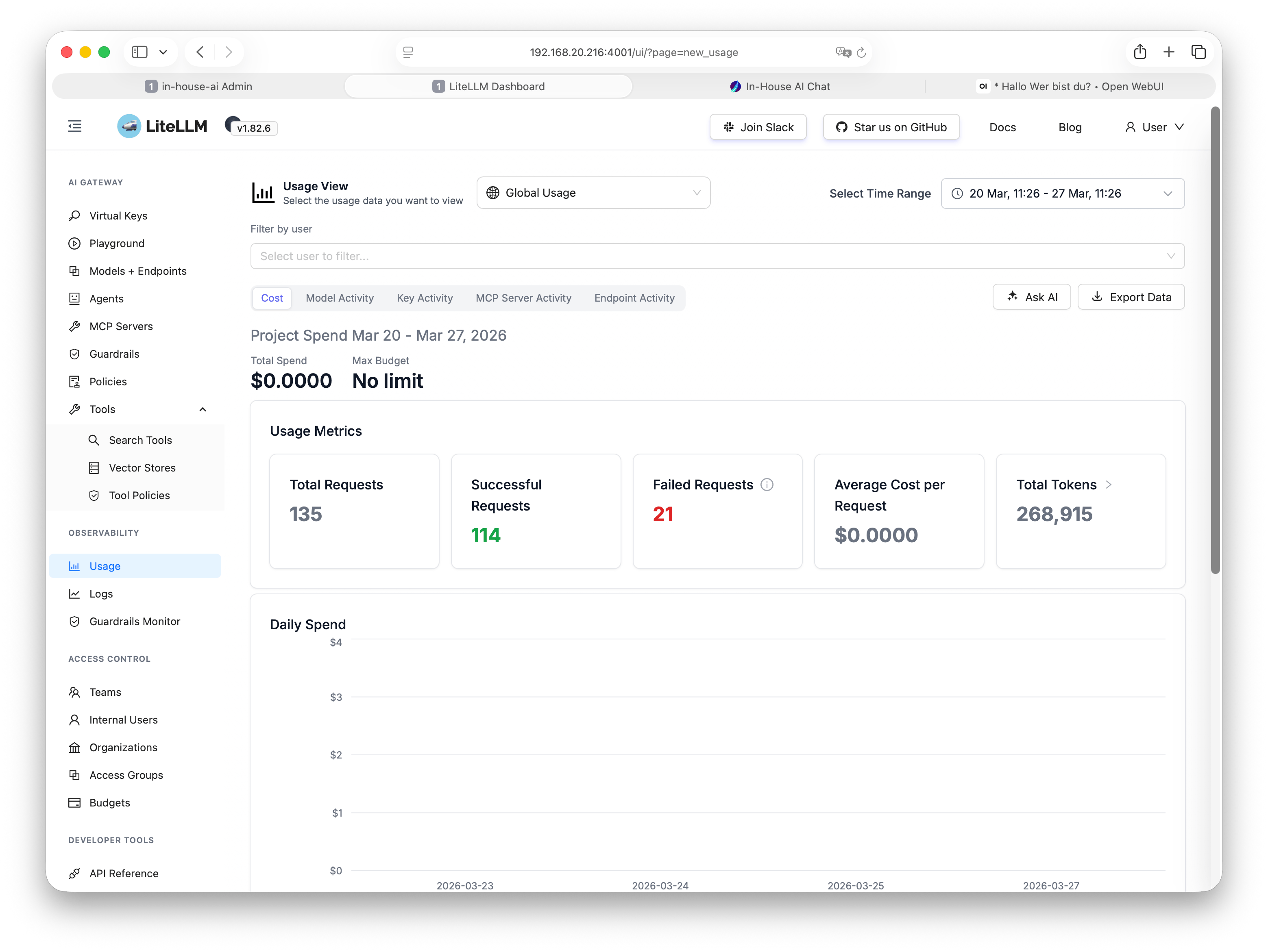

Das LiteLLM Admin-Panel in der Praxis

Nutzungsübersicht und Richtlinienverwaltung – alles in einem übersichtlichen Web-Dashboard, direkt im Browser.

Vergrößern

Vergrößern

Vergrößern

Vergrößern

LiteLLM ist das zentrale Steuerungssystem hinter Ihrer KI-Infrastruktur. Budgets festlegen, Nutzung tracken, Zugänge verwalten – vollständig auf Ihrer eigenen Hardware, ohne Cloud, ohne Datenweitergabe.

LiteLLM ist ein quelloffenes API-Gateway für Sprachmodelle. Es sitzt als unsichtbare Schicht zwischen Ihren Mitarbeitern und den KI-Modellen im Hintergrund – und gibt Ihnen vollständige Kontrolle darüber, wer was wie lange und zu welchem Preis nutzen darf.

In der Praxis bedeutet das: Abteilungsleiter sehen genau, welche Teams welche Modelle wie intensiv nutzen. IT-Verantwortliche können Budgets pro Team, Projekt oder Nutzer setzen. Und die Geschäftsleitung erhält auf Knopfdruck einen Überblick über den KI-Einsatz im Unternehmen.

Dabei bleibt alles auf Ihrer eigenen Hardware. Kein einziger Request verlässt Ihr Netzwerk. LiteLLM protokolliert intern und speichert keine Daten bei Dritten.

LiteLLM ist das Rückgrat Ihrer KI-Infrastruktur.

Während Open WebUI oder LibreChat die Oberfläche für Ihre Mitarbeiter

bereitstellen, übernimmt LiteLLM die Steuerung im Hintergrund:

Welches Modell wird aufgerufen? Ist das Budget noch verfügbar?

Wer hat in dieser Woche besonders viele Anfragen gestellt?

Gerade für Unternehmen mit mehreren Teams oder Abteilungen ist

diese Transparenz und Kontrolle unverzichtbar.

LiteLLM ist mehr als ein Proxy. Es ist das Kontrollzentrum für alle KI-Aktivitäten in Ihrem Unternehmen.

Monatliche oder wöchentliche Limits pro Nutzer, Team oder Abteilung setzen – automatische Sperrung bei Überschreitung.

Jede Anfrage wird protokolliert: Zeitstempel, Modell, Token-Verbrauch, Nutzer. Vollständige Transparenz ohne Mehraufwand.

API-Keys pro Nutzer oder Anwendung ausstellen. Jede Schlüssel kann auf bestimmte Modelle oder Budgets beschränkt werden.

Anfragen automatisch an das passende Modell weiterleiten – je nach Aufgabe, Last oder Verfügbarkeit.

Alle Modelle über eine einzige OpenAI-kompatible Schnittstelle ansprechen – egal ob Llama, Mistral oder Qwen dahinter läuft.

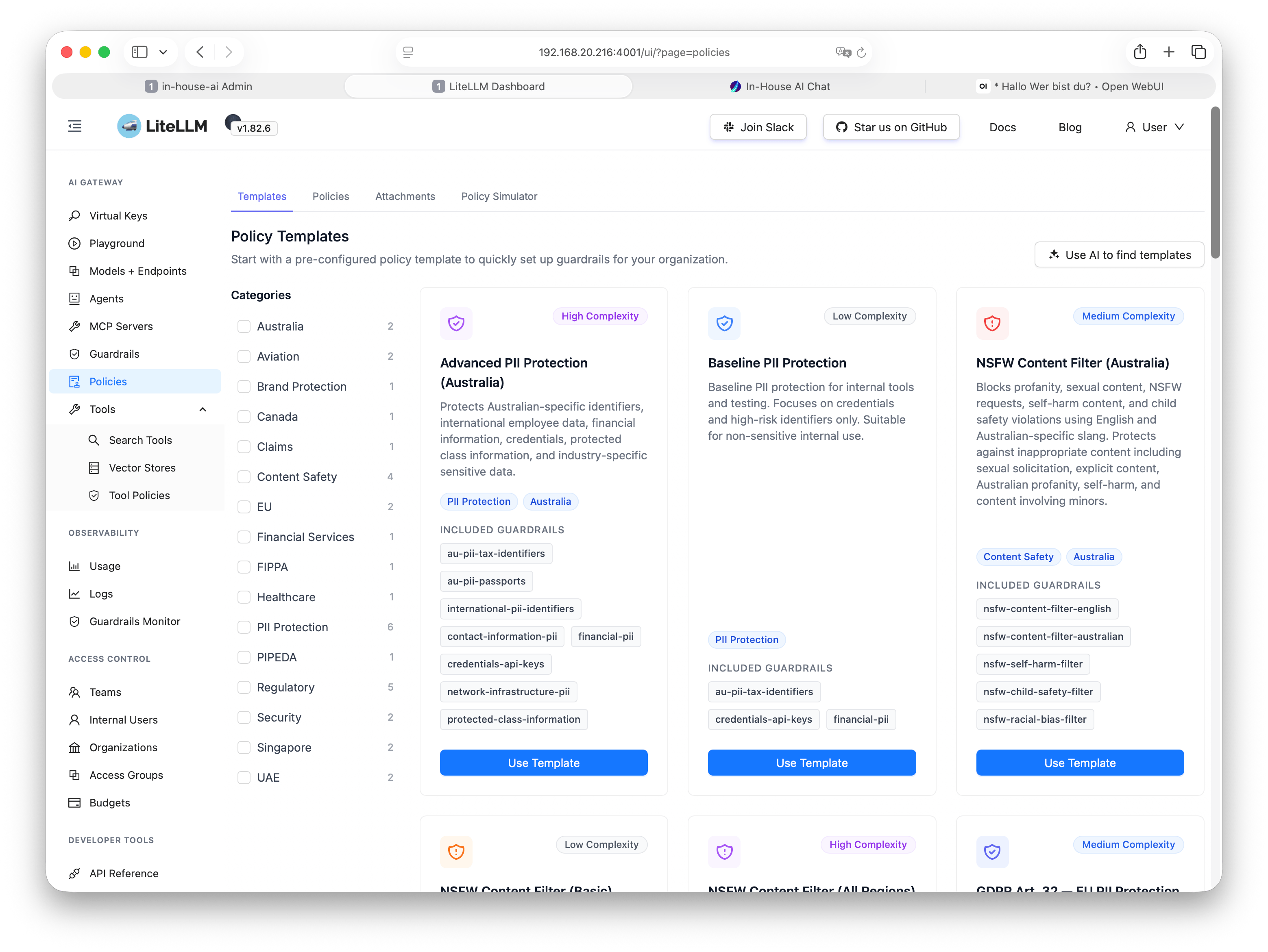

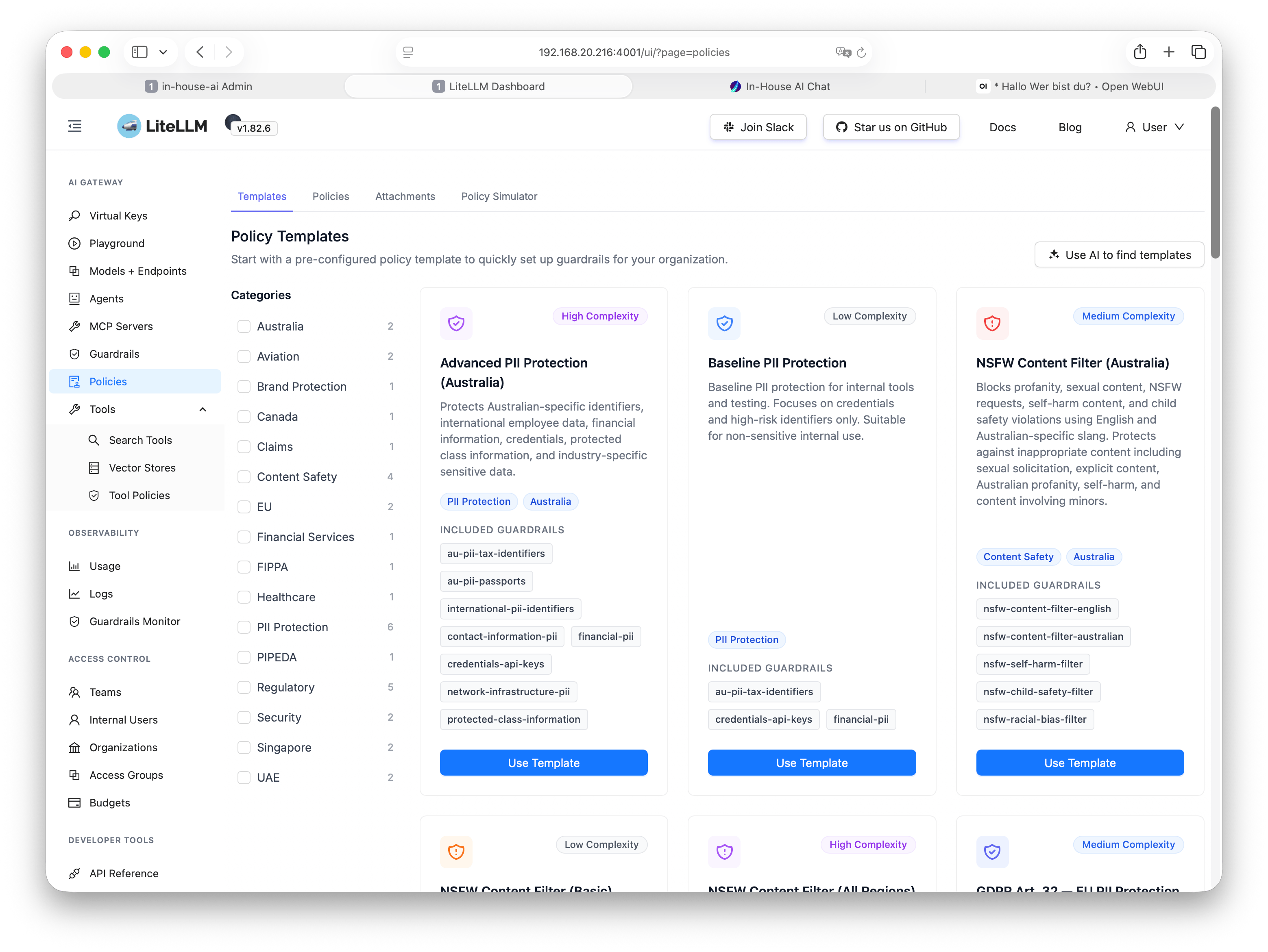

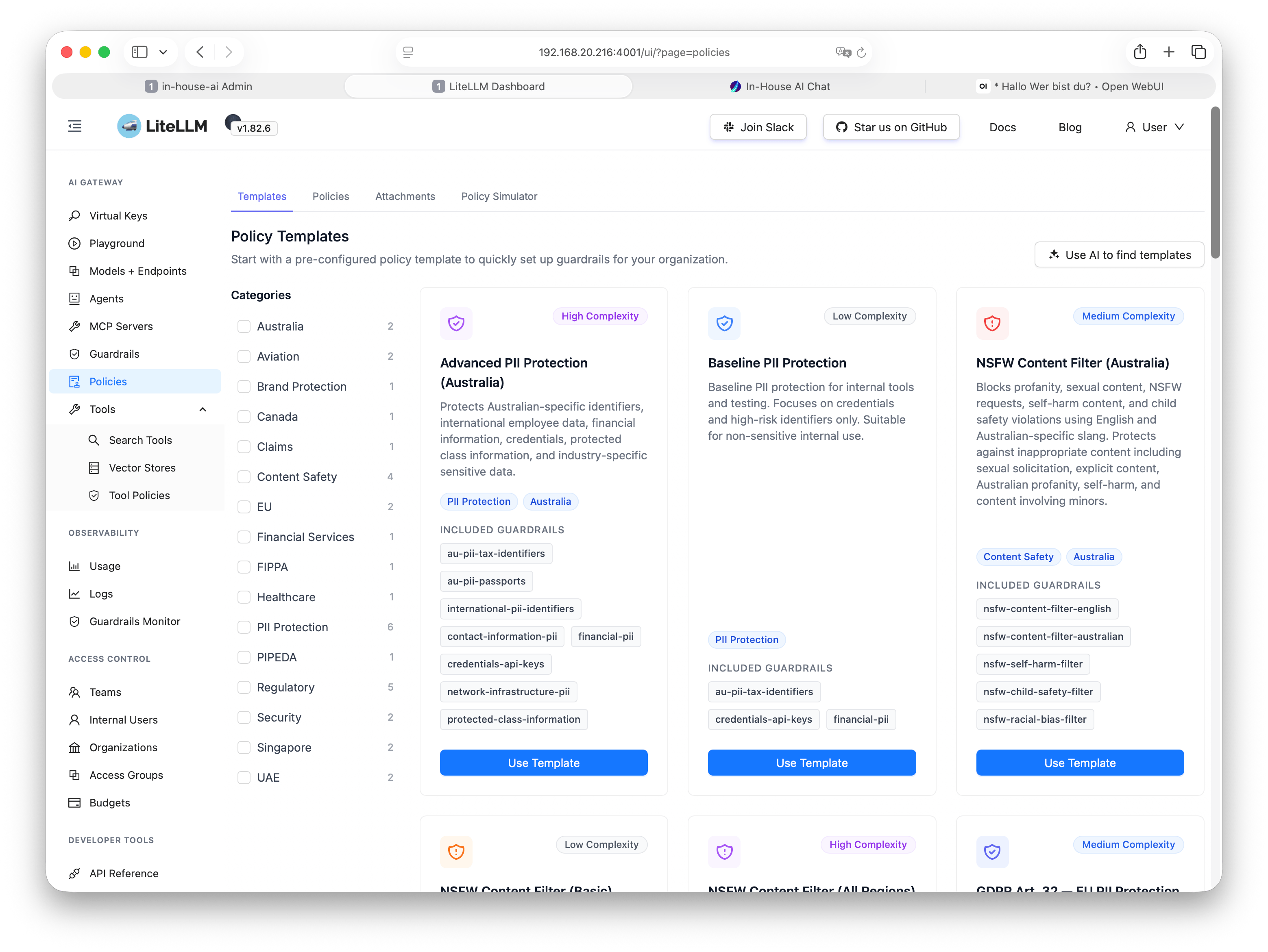

Nutzungsrichtlinien für Modelle, Inhalte und Anfragemengen zentral definieren und durchsetzen – ohne Einzelkonfiguration.

Übersichtliches Admin-Panel für alle Einstellungen – Nutzung, Budgets, Keys und Logs auf einen Blick im Browser.

Alle Logs, Statistiken und Keys bleiben auf Ihrer Hardware. Kein Drittland-Transfer, keine externen Abhängigkeiten.

Bei Ausfall eines Modells automatisch auf eine Alternative wechseln. Anfragen auf mehrere Instanzen verteilen.

Nutzungsübersicht und Richtlinienverwaltung – alles in einem übersichtlichen Web-Dashboard, direkt im Browser.

Vergrößern

Vergrößern

Vergrößern

Vergrößern

LiteLLM ist Teil unseres vollständigen KI-Stacks – wir richten alles gemeinsam auf Ihrer Hardware ein.

Wir installieren LiteLLM auf Ihrer vorhandenen oder von uns gelieferten Hardware – als Container, der automatisch startet und läuft.

Alle laufenden Sprachmodelle werden in LiteLLM eingetragen und mit sinnvollen Routing-Regeln versehen – je nach Anwendungsfall.

Wir legen Abteilungen, Budgetgrenzen und API-Keys an – nach Ihrer Organisationsstruktur, nicht nach einem starren Schema.

Sie erhalten Zugang zum Admin-Dashboard und eine kurze Einweisung. Ab dann haben Sie volle Kontrolle – und wir stehen bei Fragen bereit.

LiteLLM wird bei uns immer gemeinsam mit den passenden Chat-Oberflächen und LLM-Runnern eingerichtet. Das Ergebnis ist ein vollständiger, produktionsreifer KI-Stack für Ihr Unternehmen – aus einer Hand, auf Ihrer Hardware.

Typische Kombination: Open WebUI oder LibreChat als Chat-Oberfläche für Mitarbeiter, LiteLLM als Gateway im Hintergrund, Ollama als LLM-Runner für die Modelle. Alles zusammen eingerichtet, getestet und übergeben.

Kein Vendor-Lock-in, keine Abonnements, keine monatlichen Lizenzkosten. Einmal eingerichtet gehört das System Ihnen.

Wir zeigen Ihnen, wie LiteLLM, Open WebUI und Ihre Modelle zusammenspielen – in einer persönlichen Demo, kostenlos und unverbindlich.